Crediti: geralt/Pixabay. Licenza: Pixabay License

Secondo il Global Digital Report, nel 2018 "più di 3 miliardi di persone in tutto il mondo utilizzano i social media ogni mese", e anche giornali e agenzie di stampa tradizionali sono sempre più presenti sui social network. Piattaforme di microblogging, come Twitter, sono diventate importanti fonti di informazione, catturando le ultime notizie in tempo reale e anticipando i media tradizionali. Un sondaggio del Pew Research Centre stima nel 68% la percentuale di statunitensi che si informa attraverso i social media.

L’agevolata fruibilità dell'informazione offerta dai social media è in parte dovuta alla proliferazione di account controllati, completamente o in parte, da software che creano e/o condividono automaticamente i contenuti sulla piattaforma. Tali software, noti anche come social bot - o semplicemente bot - possono essere programmati per pubblicare automaticamente informazioni su notizie di qualsiasi tipo. Purtroppo, i bot possono anche essere programmati per finalità non benigne, quali, ad esempio, distribuire spam, incoraggiare campagne di odio, aumentare indebitamente l’influenza di personaggi pubblici e indurre pregiudizi nell'opinione pubblica, anche diffondendo e promuovendo false notizie. In ogni caso, utilizzando un’identità umana fittizia, i bot possono contribuire ad amplificare la diffusione delle informazioni fra utenti reali.

Stime recenti condotte su Twitter riferiscono che i social bot rappresentano dal 9% al 15% del totale degli utenti attivi della piattaforma1. Tali bot sono particolarmente attivi nella diffusione di contenuti a bassa credibilità: individuano persone influenzabili e le bombardano con contenuti malevoli, con una sofisticazione tale da riuscire a interagire con gli utenti tenendo conto delle loro opinioni politiche. Le azioni dei bot non risparmiano i mercati finanziari: ben il 71% degli autori di tweet sospetti su azioni americane sono stati classificati come bot da algoritmi di spambot detection. Si ritiene inoltre che i bot siano stati responsabili di manomissioni di informazioni relative a importanti consultazioni politiche, quali le elezioni presidenziali del 2016 negli Stati Uniti e il referendum Brexit nel Regno Unito.

Social e comunicazione sui migranti

Nell’articolo “The role of bot squads in the political propaganda on Twitter”,2 abbiamo utilizzato uno strumento avanzato per il rilevamento dei bot insieme a metodi innovativi per l'analisi di reti complesse3 per analizzare un corpus di tweet avente come tematica il flusso migratorio nel Mediterraneo, in particolare dall'Africa all'Italia attraverso i porti libici.

I tweet sono stati selezionati nel periodo di massima crisi per i casi Sea Watch 3 e Diciotti, da metà gennaio a metà febbraio 2019; la selezione è stata fatta in base alla presenza nei messaggi di specifiche parole chiave, quali “migranti”, “ONG”, “scafisti”, “barconi”, “guardia costiera libica”, “sbarco”, eccetera. L’analisi sulla propagazione dei tweet ha evidenziato come i bot giochino un ruolo centrale nello scambio di contenuti significativi, e che i cosiddetti nodi hub (cioè gli account più efficaci nel propagare significativamente i loro messaggi e quindi i più ascoltati) hanno tra i loro follower un alto numero di bot.

Inoltre, è emerso che alcuni di questi hub, ai quali può essere assegnata la stessa tendenza politica, condividono diversi bot come follower: gli hub e le loro squadre di bot si uniscono per aumentare la visibilità e l’impatto dei messaggi di tutto il gruppo.

Le comunità politiche

Abbiamo raccolto 1.082.029 tweet, inviati da 127.275 account distinti su un periodo di un mese (dal 23 gennaio 2019 al 22 febbraio 2019). Basandosi sul sopramenzionato strumento per il rilevamento dei bot, tutti gli account sono stati classificati come genuini o come bot. Questa classificazione ha portato a identificare 117.879 account genuini e 9.396 bot.

Inoltre, sfruttando la possibilità offerta da Twitter di fornire (su richiesta del proprietario dell'account) una certificazione ufficiale sull'autenticità dell'account (la procedura è adottata principalmente da VIP, partiti politici, giornali, radio e televisioni, al fine di ridurre l'interferenza di utenti falsi), abbiamo suddiviso gli utenti in verificati e non verificati. Partendo da questa suddivisione, abbiamo poi “colorato” politicamente gruppi di utenti assumendo che chi condivide con in suoi follower i post di un utente verificato (ovvero ne retwitta i contenuti), ne condivide anche l’orientamento politico.

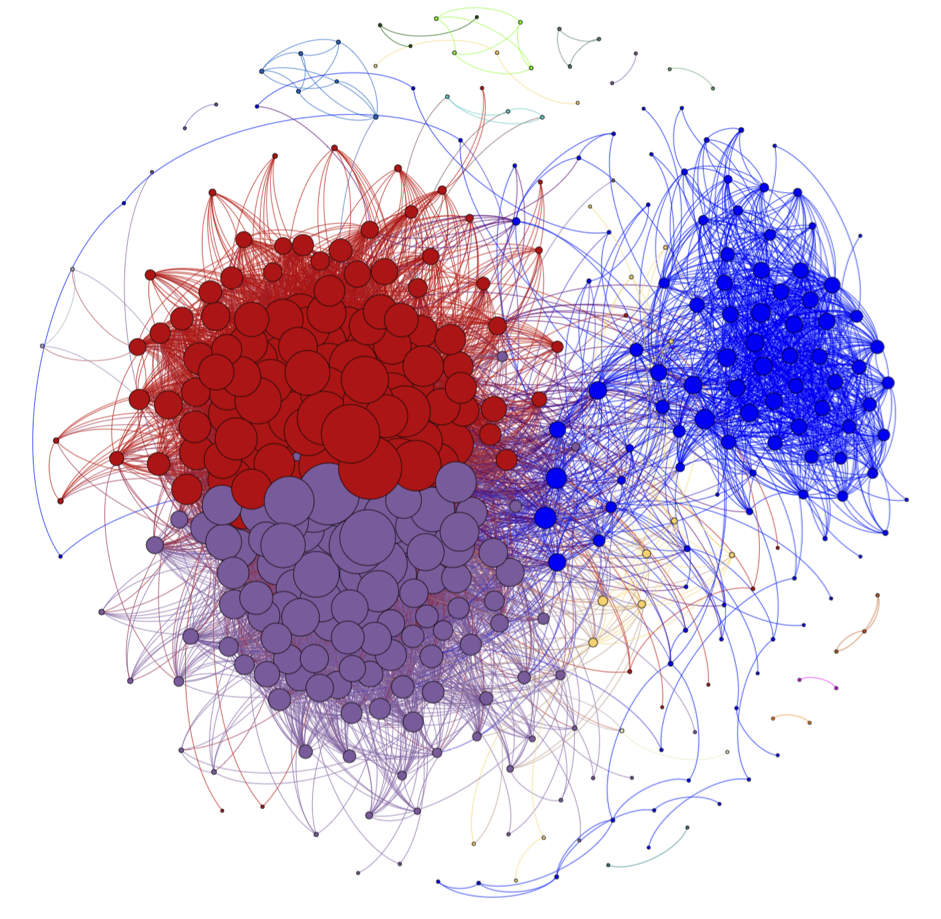

Questo esercizio ha evidenziato l’esistenza delle comunità presentate nella figura sottostante: la comunità blu è costituita da account collegati al governo italiano, ai partiti di destra, alla Lega, al Movimento 5 Stelle e alla testata Il Fatto Quotidiano con i suoi giornalisti. La comunità rossa è collegata al Partito Democratico Italiano (PD) e ad altri partiti alla sua sinistra. Il gruppo viola comprende diverse ONG, politici a sinistra del PD, diversi giornali online e offline. In arancione, alcuni account collegati alla Chiesa cattolica e in turchese piccoli gruppi legati al governo di Malta. I puntini verdi evidenziano invece una piccola comunità di commentatori calcistici (sic!).

Figura 1. I diversi gruppi di utenti su Twitter

Le squadre di bot

Per valutare il ruolo dei diversi account nello scambio di messaggi su Twitter, abbiamo filtrato la rete dei retweet. In pratica, abbiamo considerato solo quei retweet che non possono essere spiegati semplicemente dall’attività casuale dei diversi utenti. Se un account focalizza tutti i suoi retweet sui contenuti di pochi utenti, mostra una certa predilezione verso i loro messaggi: concentrarsi su questi scambi permette di analizzare solamente le condivisioni significative per il dibattito online. Abbiamo quindi ottenuto una rete diretta tra account, dove un link rappresenta una condivisione sostanziale di messaggi e la freccia va da chi viene condiviso a chi condivide. A ogni nodo di questa rete “filtrata” abbiamo poi aggiunto il tag dell’affiliazione politica ottenuto nell’analisi precedente.

Studiando la centralità dei diversi nodi in termini di numeri di collegamenti (punteggio hub), abbiamo visto che l’account col punteggio più alto è quello del Senatore Matteo Salvini, il secondo e il terzo sono di due giornalisti di un sito di notizie sostenuto dal movimento politico di Casa Pound, il quarto è dell’Onorevole Giorgia Meloni, il quinto de Il Fatto Quotidiano. I primi 175 account della lista dei punteggi hub sono tutti dello schieramento blu. Il primo account con un diverso colore è il TgLa7 al 176 posto.

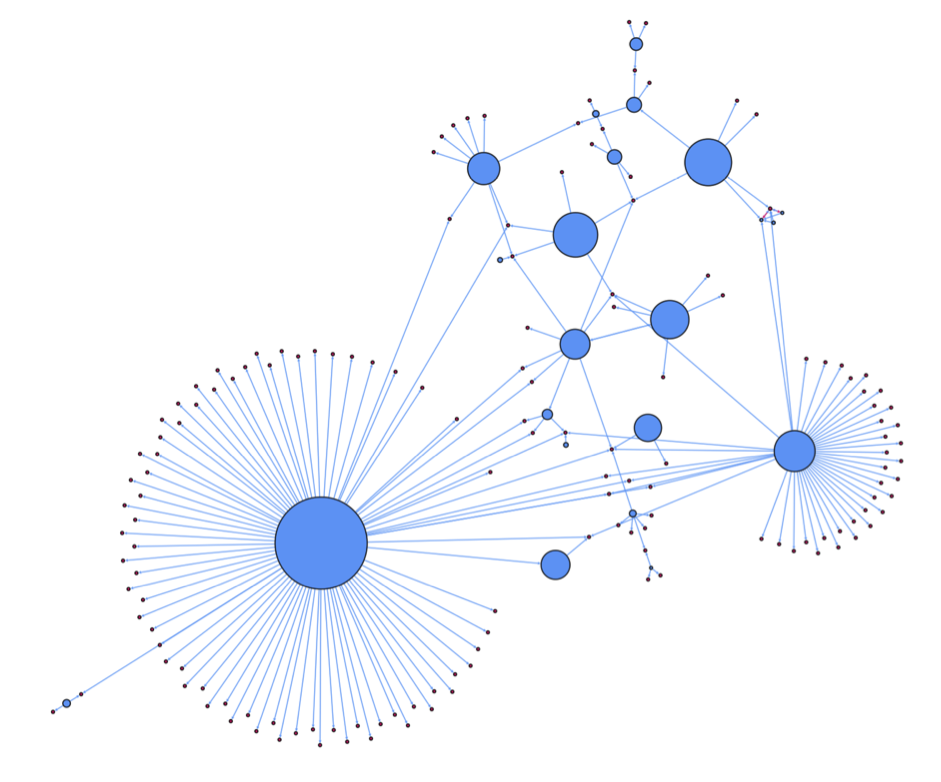

Infine, abbiamo preso in considerazione il ruolo dei bot all’interno delle diverse comunità. La figura sottostante mostra il sottografo del più grande gruppo di utenti (quello blu) che condividono gli stessi bot tra i loro follower. Il sotto grafico include gli account umani (in azzurro) e tutti i bot che li seguono (in fucsia chiaro). La dimensione dei nodi è proporzionale ai punteggi hub. Il nodo più grande è quello del Senatore Matteo Salvini. È importante notare che nella figura ci sono 22 bot condivisi da account umani che sono nella lista dei primi 10 account per i punteggio hub: questi account appartengono esclusivamente alla comunità blu.

Figura 2. Il ruolo dei bot nelle diverse comunità di utenti Twitter, e in particolare il sottografo del più grande gruppo di utenti che condividono gli stessi bot tra i loro follower

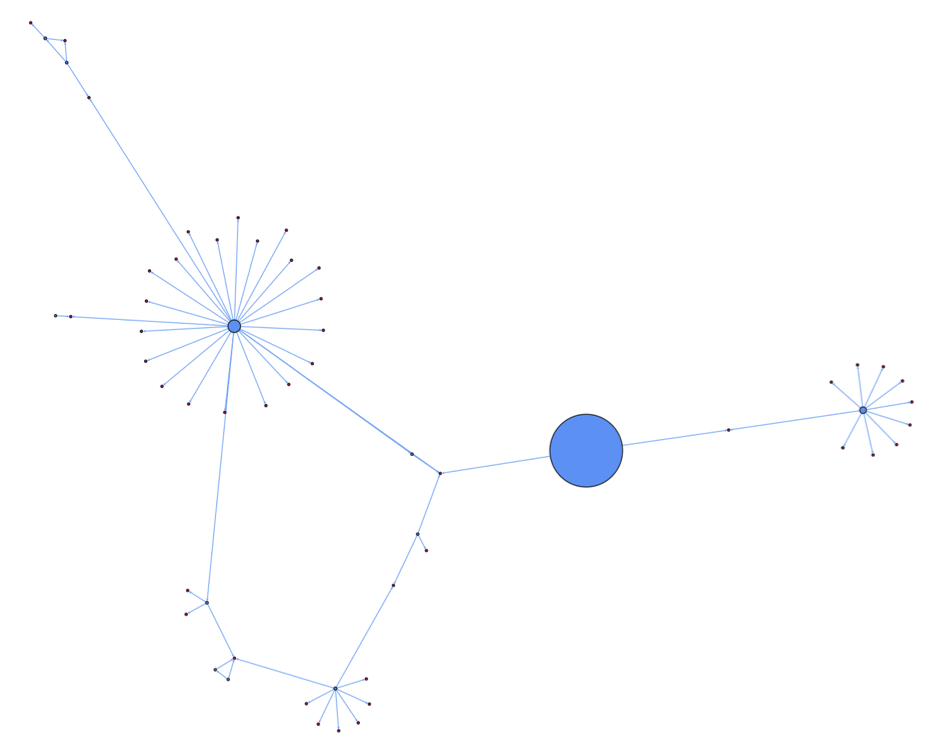

La prossima figura rappresenta invece il sottografo del secondo gruppo di utenti che hanno follower bot in comune. Anche in questo caso, gli account umani sono in azzurro e tutti i bot che li seguono in fucsia. Le dimensioni dei bot sono proporzionali al punteggio dell’hub, ma normalizzate sul sottografo. Quindi, la dimensione del nodo più grande nella figura precedente è 362 volte maggiore del più grande riportato qua sotto. L'impatto dei nodi di questo grafico è molto più limitato: il nodo più forte, cioè il nodo più grande della trama, è l’account ufficiale di TgLa7, i bot condivisi sono minimi e gli account appartengono quasi esclusivamente alla comunità viola.

Figura 3. Il sottografo del secondo gruppo di utenti con bot in comune

I rischi della disintermediazione

Molti commenti sono possibili su questi risultati, ma noi ci limiteremo solamente a considerazioni di carattere generale. Appare chiaro come anche il mondo delle notizie sia stato grandemente modificato dalla rivoluzione di Internet. In questa rivoluzione, la maggiore connessione tra utenti ha generato una minore distanza all’interno della società, rendendo possibile entrare in contatto direttamente con persone di ogni parte del mondo. Questo processo di disintermediazione, che è stato così apprezzato in economia, presenta però degli evidenti rischi per quello che riguarda il mondo delle notizie e più in generale delle scienze sociali.

Nella nostra Costituzione è scritto che “La sovranità appartiene al popolo, che la esercita nelle forme e nei limiti della Costituzione”. Siamo riusciti a dare a ognuno il potere di creare e commentare le notizie, ma non abbiamo ancora definito né le forme né i limiti (qualora fossero necessari) di tale potere. In attesa che la politica trovi un modo di regolare questi mezzi di comunicazione, il compito della ricerca è di descrivere e spiegare il mondo che ci circonda, lasciando che ogni persona prenda una decisione il più informata possibile sui fatti e sulle opinioni espresse riguardo tali fatti.

Note:

1. Varol O, Ferrara E, Davis CA, Menczer F, Flammini A. Online Human-Bot Interactions: Detection, Estimation, and Characterization. 11th Conference on Web and Social Media, 280-289 (2017)

2. Caldarelli G, De Nicola R, Del Vigna F, Petrocchi M, Saracco F. The role of bot squads in the political propaganda on Twitter. Attualmente in fase di revisione per la pubblicazione su rivista internazionale e disponibile su http://arxiv.org/abs/1905.12687

3. Cresci S, Di Pietro R, Petrocchi M, Spognardi A, Tesconi M. Fame for sale: efficient detection of fake twitter followers. Decision Support Systems 80, 56–71(2015)

4. Cimini G, Squartini T, Saracco F, Garlaschelli D, Gabrielli A, Caldarelli G. The Statistical Physics of Real-World Networks. Nat. Rev. Phys. 1, 58–71 (2019). URL http://www.nature.com/articles/s42254-018-0002-6 e https://arxiv.org/abs/1810.05095