Maria Luisa Villa – già ordinaria di Immunologia presso l’Università degli Studi di Milano, Associata di Ricerca all’Istituto di Tecnologie Biomediche del Cnr, socia dell’Accademia della Crusca – ci propone un libro dal titolo sornione e accattivante: La scienza sa di non sapere. Per questo funziona. (Guerini e Associati 2016).

In dodici concisi capitoli, Villa visita la “cosa” scientifica dalle radici epistemologiche e metodologiche; al formarsi della scienza moderna; ai problemi dell’autorità, dell’autorevolezza, della certezza, della credibilità della scienza; al piacere di praticarla, fino al problema della lingua nella quale esprimerla, navigando abilmente tra proposte e desideri senza mai affondare nella disputa sull’uso dell’inglese nelle Università italiane. Caratteristica della Villa è la frequentazione paritetica di problemi epistemologici e di problemi di organizzazione della ricerca. Ne sono testimonianza le bibliografie affisse a ogni capitolo, nelle quali Koyré, Feynman, D’Alembert, Marx, Kant, Popper, ovviamente un raffinato testo di Galilei – le “sensate esperienze” e le “necessarie dimostrazioni” sono un Leitmotiv del libro –, perfino un Heisenberg fiancheggiano aggiornati documenti contemporanei, spesso in forma di siti Web.

"Sapere che" e "sapere come"

Centrale e soggiacente a tutto il suo discorso è quanto esposto nelle pagine centrali, appunto, del libro, dalla fine del Capitolo settimo a tutto il Capitolo ottavo. Di che si tratta? Della coniugazione di due polarità: la prima è quella tra “sapere che” e “sapere come” (p. 73); la seconda è quella tra ricerca di base e ricerca applicata. Il sapere comune è un sapere “come”, il sapere scientifico è il sapere “che”, o “perché”. D’altra parte la ricerca applicata è certamente sia scientifica, sia orientata al “come”. Siamo in presenza di un paradosso? La spiegazione è storica e metodologica. Storica perché la ricerca applicata, più precisamente lo sviluppo di procedure e apparecchiature volte a scopi concreti, sviluppo basato sul “come”, ha spesso preceduto la conoscenza scientifica, o di base, del perché quelle procedure e apparecchi “funzionavano”. Metodologica perché le azioni sia di pensiero, sia materiali e sperimentali hanno avuto forme diverse tra l’aggredire il “come” e il trovare il “perché”.

Il caso esemplare della storia delle vaccinazioni

Scrive Villa: “La storia delle vaccinazioni offre un materiale esemplare per comprendere ciò che distingue l’esperimento dalla semplice osservazione. …Il vaiolo delle vacche, o vaiolo vaccino, era ben noto nelle campagne inglesi e i contadini sapevano che esso si poteva trasmettere all’uomo dando una forma di vaiolo benigno, che però rendeva successivamente immuni all’altro vaiolo, il pericoloso vaiolo umano” (p. 30). Edward Jenner (1749-1823) nel 1796 colse l’importanza della cosa dando inizio, senza saperlo, all’immunologia di cui Villa è, tra le altre cose, maestra. Segue una serie di eventi che portano a Pasteur (1822-1895), e Koch (1843-1910), chiaramente illustrati nel libro, e a molti altri fino ai premi Nobel Metchnikov (1845-1916), ai più recenti Macfarlane Burnet (1899-1985), alle reti di Niels Jerne (1911-1994) e alle moderne, complesse, conoscenze intrise di tecnologia che hanno portato a una maggiore, ma sempre aperta, comprensione del meccanismo immunologico e alla sua applicazione.

Non si può parlare di Jenner senza che venga in mente un altro medico, forse all’epoca più influente di lui, Samuel Hahnemann (1755-1843), il quale, seguendo il suo pensiero che “il simile cura il simile” e senza l’evidenza del sapere comune di Jenner, ma singolarmente, negli stessi anni e con un’innegabile somiglianza procedurale, dette origine al discusso movimento omeopatico.

Dal "come" al "perché"

Vediamo più da vicino come si realizza il passaggio dal “come” al “perché”. È largamente accettato che la conoscenza del mondo esterno – sulla conoscenza della matematica incombe la sentenza dell’Ateniese in merito all'arithmos nell’Epinomis platonico – ha origine dalla percezione. Paragono il processo conoscitivo a una tenaglia le cui due ganasce afferrano l’oggetto da due parti: una è l’esperienza percettiva diretta: la terra è piatta, il sole gira nel cielo, ecc. L’altra è un cammino, che può durare secoli perché sia scoperto, e che alla fine termina anch’esso in una percezione diretta, perché non c’è nulla di arcano nella conoscenza scientifica ed anch’essa ultimativamente si fonda sulla percezione sensoriale (degli strumenti!), ma passando attraverso dispositivi, esperimenti, ragionamenti. I risultati di questo secondo braccio della tenaglia sono quasi sempre controintuitivi perché normalmente contrastano con quelli della percezione diretta.*

* Esempi significativi di contrasti

| senso comune | conoscenza | spiegazione |

|---|---|---|

| la terra è piatta | la terra è sferica | noto fin dai Greci |

| la terra è ferma e il sole si muove | la terra gira attorno al sole | Copernico |

| un bastone immerso nell'acqua appare piegato | il bastone rimane diritto | fenomeno di rifrazione |

| i segmenti della figura di Müller-Lyer hanno lunghezza diversa | i segmenti della figura di Müller-Lyer hanno stessa lunghezza | Gestalt, psicologia sperimentale, neurologia |

| il tempo newtoniano e intuitivo che equabiliter fluit. La simultaneità vale per tutto lo spazio | il tempo dipende dallo stato di moto dell'osservatore | relatività ristretta: velocità piccolissime rispetto alla velocità della luce |

| il soggetto è libero di agire | le azioni sono predisposte dal cervello indipendentemente dalla volontà del soggetto (ferve la discussione) | non c'è spiegazione |

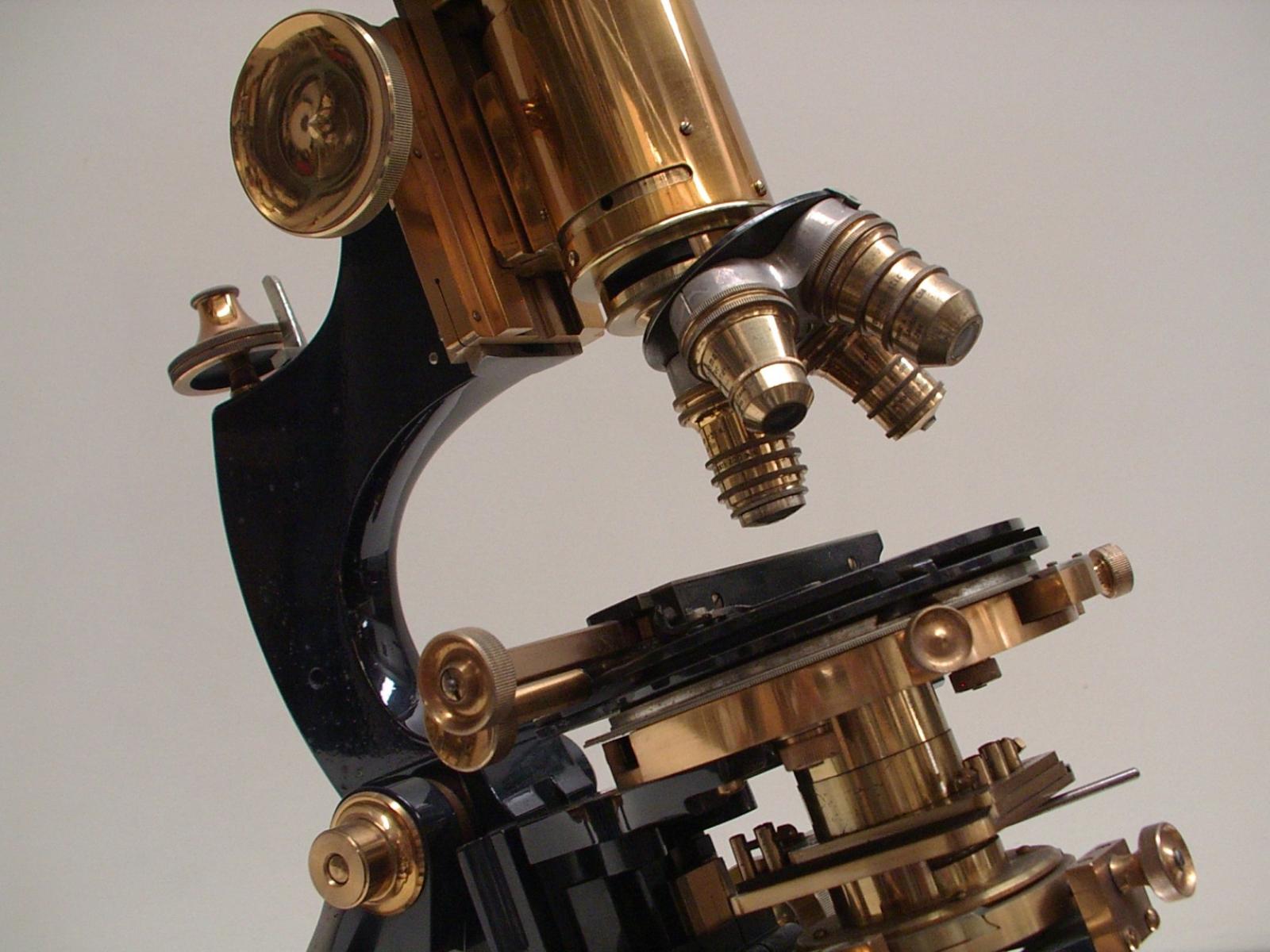

Il ruolo degli strumenti scientifici

Mi sia concesso di usare un termine di elettrotecnica per questo secondo cammino e chiamarlo un adattamento di impedenza. Come i trasformatori elettrici mantengono l’energia, ma la trasformano secondo le esigenze della produzione e dell’utilizzazione – caratterizzate appunto dalle loro impedenze –, così gli strumenti scientifici trasformano in maniera appropriata alla sensorialità umana il contenuto conoscitivo della cosa osservata. Spesso questo “trasformatore” comporta un elemento strumentale essenziale.

Il trasformatore essenziale nel passaggio dai contadini inglesi osservati da Jenner ai Pasteur, Koch ed altri è stato il microscopio.

Anche Galilei ha usato un trasformatore: il cannocchiale. E questo era stato sviluppato prima di Galilei. Occhiali erano prodotti fin dal medioevo. Ne Il nome della rosa Guglielmo si procura degli occhiali. Ma l’indagine sul perché dei fenomeni ottici si concretizza dopo occhiali e cannocchiali, prevalentemente con Willebrod Snell (1580-1626) e René Descartes (1596–1650). Per tacere della sistemazione dei moti celesti – drammaticamente promossi da Galilei – che dalle astuzie tolemaiche devono aspettare Keplero e Newton.

L'esempio della macchina a vapore

Dalla scienza greca si sapeva confusamente che il fuoco ha una potenza motrice: la Eolipila di Erone (I sec d.C.). Denis Papin (1647-1712) nel 1679 inventa la pentola a pressione. Nel 1687 realizza, senza successo, un dispositivo a vapore con pistone che già contiene le idee che saranno sviluppate nel secolo successivo. Nel 1698 un certo Thomas Savery ottiene “a patent for an engine to raise water 'by the Impellent Force of Fire’”. Ma senza pistone. Il socio di Savery, Thomas Newcomen, introduce nel 1712 il pistone per azionare una pompa. James Watt (1736-1819) nel 1781, sulla base della pompa di Newcomen, realizza un motore: rotazione, potenza meccanica. Grande successo commerciale. Subito nascono litigazioni tra la Watt & Boulton e altri inventori. Tuttavia migliorie sul rendimento delle macchine termiche incontrano limiti che sembrano invalicabili. Perché?

Nicolas Léonard Sadi Carnot (1796-1832) scrive nel 1824 le Réflexions sur la puissance motrice du feu nelle quali, sia pure fondandosi sulla errata ipotesi del calorico, stabilisce che il ciclo termico, che sarà chiamato il Ciclo di Carnot, possiede il massimo rendimento possibile per qualsiasi macchina che lavori tra due – una sola non basta – date sorgenti di calore. È il primo gradino verso il 2° principio della termodinamica. Curiosamente Julius Robert von Mayer (1814-1878) enuncia solo nel 1845 il principio della conservazione dell'energia (energia libera: forse la cosa più vicina alla energeia aristotelica) che sarà chiamato il 1° principio della termodinamica da Rudolf Julius Emanuel Clausius (1822-1888) e William Thomson (Lord Kelvin 1824-1907). Si comincia a capire “perché” il calore ha potenza meccanica. James Prescott Joule (1818-1889) stabilisce l’equivalente meccanico del calore nel 1845 pari a 4,184 J/cal. Ma è solo con la statistica di James Clerk Maxwell (1831-1879) e Ludwig Eduard Boltzmann (1844-1906), nel decennio 1860-1871, che il calore viene riconosciuto come un tipo statistico di moto meccanico. Il trasformatore essenziale della termodinamica è la macchina a vapore.

L'applicazione precede spesso la conoscenza

È impressionante questa lunga marcia, compendiosamente esposta alle pp. 103-105, che parte dalla superficiale osservazione della potenza motrice del fuoco e perviene alla scienza termodinamica. Osserviamo che l’applicazione ha sempre preceduto la conoscenza di base almeno finché quest’ultima, imponendosi con la sua autorevolezza, non ha permesso lo sviluppo di applicazioni sempre più avanzate. Ma osserviamo anche che questa autorevolezza è lungi dall’essere totalmente assicurata. Nei tre esempi citati, la conoscenza della cellula vivente, la conoscenza dell’universo e perché il tempo, secondo il 2° principio della termodinamica, abbia una sola direzione dal passato al futuro, sono problemi aperti, pur su basi assestate con certezza. Si può ben dire che la scienza sa, ma ancora più prezioso è il fatto che sappia di non sapere.

Piuttosto anomala la situazione epistemica dell’informatica, che la Villa non tratta esplicitamente ma che, come ormai in qualunque attività scrittoria o altra, è surrettiziamente presente nel libro, non foss’altro che per i numerosi siti web (sitografia, ormai) che occorrono nei riferimenti bibliografici (e probabilmente nello strumento di scrittura dell’autrice!).

Dagli algoritmi ai computer

Le radici dell’informatica risiedono nella nozione di algoritmo e nelle macchine calcolatrici. Il primo è, insieme al numero – l’arithmos citato più sopra –, l’elemento fondante della matematica nelle civiltà più antiche e diverse e consiste nelle regole per calcolare correttamente le soluzioni dei problemi numerici. Prende nome dal grande al-Khwārizmī (750 circa nell’odierno Uzbekistan -850 circa a Baghdad), la cui opera fu conosciuta nel medioevo occidentale col nome generico di algorismus. Le seconde, per non entrare in discussioni storiografiche, si possono far risalire all'addizionatrice nota come Pascaline (1645) di Blaise Pascal (1623-1662). Mentre gli algoritmi erano riconosciuti come procedure mentali, già con la macchina di Pascal, ma anche prima più modestamente con l’abaco, la procedura mentale si materializzò e, in una successione di invenzioni, a partire dalle schede perforate dei telai Jacquard, antesignane delle schede IBM, attraverso molte macchine calcolatrici tra cui spicca la macchina analitica (progettata nel 1837) di Charles Babbage (1791-1871), la diffusione nella prima metà del Novecento delle machines IBM fino ai primi calcolatori elettronici programmabili, frutto purtroppo dello sforzo produttivo bellico nella Seconda guerra mondiale, ai quali sono legati i nomi di John von Neumann (1903-1957) e di John Presper Eckert (1919-1995) e John Mauchly (1908-1980).

Parallelamente, ma principalmente dalla fine dell’Ottocento con la cosiddetta crisi dei fondamenti, l’algoritmo cominciò ad essere studiato in sé e non solo per i risultati operativi conseguiti. Ne seguì la ben nota successione di definizioni, poi dimostrate equivalenti, legate ai nomi – tra gli altri – di Emil Post (1897-1954), Alan Turing (1912-1954), Kurt Gödel (1908-1978), intrecciate con gli sviluppi della logica formale e i grandiosi risultati di limitazione di ciò che è calcolabile algoritmicamente.

L' "arte" della programmazione

L’anomalia dell'informatica consiste nel fatto che né l’aspetto materiale-applicativo dell’algoritmo – le macchine calcolatrici che nei secoli si sono succedute – né l’aspetto teorico-astratto, che potremmo chiamare la ricerca di base, si sono mai influenzati reciprocamente. L’anomalia è tanto più marcata in quanto, anche dopo che i due aspetti si incontrarono negli anni Cinquanta del Novecento per opera inizialmente di von Neumann, dopo alcuni risultati di collegamento tra la tecnologia già avanzata delle macchine calcolatrici – d’ora in poi computer – e alcune strutture astratte come la teoria degli automi finiti, utile sia nella costruzione dei circuiti sia nella redazione dei loro programmi, o le grammatiche formali derivate dai lavori di Noam Chomsky (1897) e Marcel-Paul (Marco) Schützenberger (1920-1996), la teoria astratta degli algoritmi o della calcolabilità ha avuto una modesta influenza sulla ricerca di base o sulla realizzazione industriale dei computer.

La ragione ne potrebbe risiedere nel fatto che la teoria degli algoritmi ha studiato e studia principalmente le limitazioni e le demarcazioni tra classi di algoritmi e – per strano che possa sembrare – non come costruire algoritmi o analizzarne le proprietà computazionali. Per esempio è dimostrato che il collaudo degli artefatti computazionali è “doppiamente” impossibile nel senso che il problema generale di accertare se un dato programma soddisfi le specifiche di progetto rimarrebbe indecidibile anche se il celebre problema della fermata della macchina di Turing fosse, per assurdo, decidibile. È chiaro che risultati di tal genere non aiutano nella progettazione di algoritmi. Di fatto l’informatica è un’attività scientifica nella quale non si distinguono, ad onta di nomi ormai assestati quali “informatica teorica” o “ingegneria del software”, attività di ricerca spiccatamente di base o di ricerca applicata. Mentre, poniamo, nella ingegneria meccanica è fondamentale l’apporto di discipline di base quali la meccanica e la scienza dei materiali per fondare e sostenere la disciplina applicativa della scienza delle costruzioni, in informatica tali sostegni non esistono. Non a caso un trattato di Donald Knuth (1938), celebre nonostante che solo tre dei previsti sette volumi siano stati completati, The Art of Computer Programming (1968–) denuncia addirittura nel suo titolo che la ricerca, progettazione e applicazione degli algoritmi non è una scienza, ma un’arte.

L'universo totalizzante dell'informatica

Nel suo recente La matematica degli dèi e gli algoritmi degli uomini (Adelphi 2016), Paolo Zellini (1946), docente di Analisi numerica e profondo conoscitore della storia e del senso della matematica, scrive: “La scienza degli algoritmi ebbe uno sviluppo tumultuoso per tutto l’arco del Novecento e raggiunse un culmine nelle definizioni formali degli anni Trenta, per poi dividersi, in seguito alla costruzione dei primi calcolatori digitali, in due filoni complementari e relativamente contrapposti: da un lato l’informatica teorica, con una teoria astratta della calcolabilità e della complessità computazionale, dall’altro una scienza del calcolo su grande scala deputata a risolvere problemi della matematica, dell’economia, dell’ingegneria o dell’informatica in termini puramente aritmetici e numerici. I molteplici risvolti filosofici di questo secondo filone non sono stati ancora abbastanza chiariti, ma è già evidente, nella sensibilità di chiunque, quanto abbia inciso, in ogni settore della vita, della cultura e dell’assetto sociale, il moltiplicarsi di una varietà diversificata di processi di calcolo deputati a risolvere problemi specifici della più varia natura (pp. 13-14)”.

Nella sobria prosa di Zellini, la “varietà diversificata di processi di calcolo” allude a quel fenomeno sociale, politico, tecnico, scientifico, artistico, ossia totalizzante, che abbiamo sotto gli occhi e nel quale viviamo: smartphones, App, WEB, decisioni algoritmiche dei mercati finanziari, ecc. Per l’informatica una distinzione tra disciplina di base e disciplina applicata non esiste e il processo sociale moderno non riconosce più le antiche (cioè di cinquant’anni fa) frontiere, né si vede un qualche cenno di comprensione o di sviluppo comprensibile della tecnologia. Ancora una volta sappiamo di non sapere, ma funzioniamo?

Per concludere sobriamente limitiamoci ancora una volta a dire con la Villa: “…la dicotomia tra scienza di base e ricerca applicata non corrisponde a una reale barriera … (p. 82)”.